Aprenda a usar la Inteligencia Artificial en sus estudios de Ph.D. sin riesgos

La llegada de la Inteligencia Artificial ofrece enormes oportunidades de innovación y mejora en varios dominios y tareas, pero, no es menos cierto que requiere una cuidadosa consideración de los riesgos en los que se puede incurrir.

Ante la pregunta: ¿Está bien usar la Inteligencia Artificial en sus investigaciones? La respuesta es: ¡Absolutamente!, tomando muy en serio la herramienta y aplicándola de una manera responsable y aceptable.

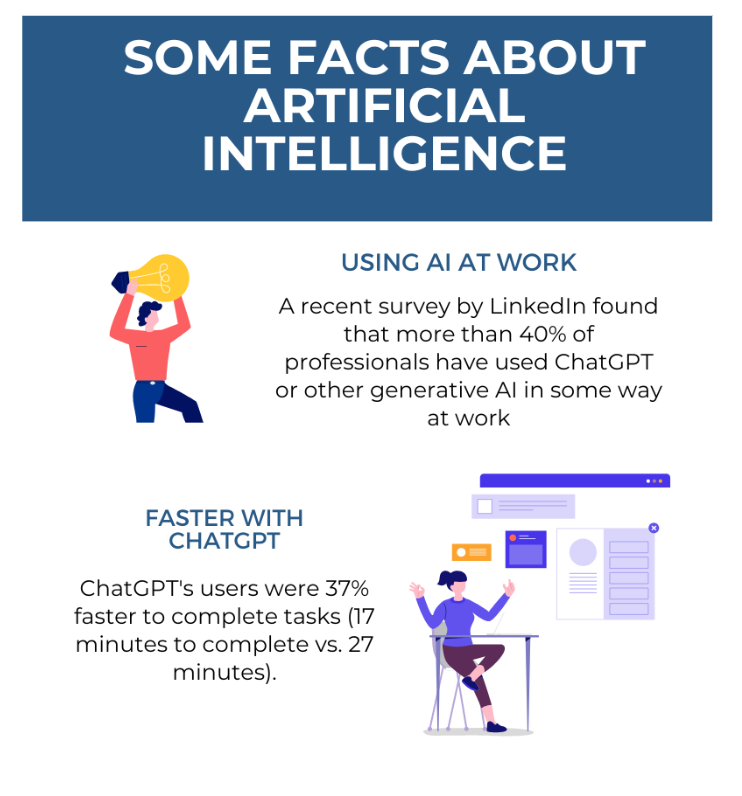

Una encuesta reciente hecha por LinkedIn, encontró que más del 40% de los profesionales han usado ChatGPT u otra IA generativa de alguna manera en el trabajo. Sin embargo, el 68 % admite que lo está empleando sin el conocimiento de su jefe. Esto sugiere un nivel de incertidumbre sobre cómo las empresas podrían percibir el uso de dicha tecnología en el lugar de trabajo.

Definitivamente, herramientas como ChatGPT, Bard y Midjourney, pueden mejorar la productividad, incluso aportar a la creatividad, al automatizar tareas como escribir textos, crear gráficas, redactar correos electrónicos, crear presentaciones de diapositivas y mucho más.

Una encuesta realizada evidenció que “los usuarios de ChatGPT fueron un 37% más rápidos en completar tareas (17 minutos para completar frente a 27 minutos) con calificaciones (nivel de calidad) más o menos similares, y a medida que los usuarios de ChatGPT repetían sus tareas, la calidad de su trabajo aumentó significativamente más rápido”.

“Un nuevo estudio de investigadores de Stanford y MIT encontró que el uso de un asistente basado en GAI aumentó la productividad en un 14 % en promedio, con el mayor impacto en los trabajadores novatos y poco calificados que pudieron completar el trabajo un 35 % más rápido con la asistencia de la herramienta. También descubrieron que la asistencia de IA mejoró el sentimiento del cliente, redujo las solicitudes de intervención gerencial y mejoró la retención de empleados”.

¿Qué puntos tomar en cuenta al apoyarse en AI?

PRIVACIDAD: Es importante estar atentos a los datos que se comparten al crear prompts. Números valiosos para la empresa o incluso datos personales. Un caso real es el de la empresa Samsung, donde los empleados filtraron información confidencial de la empresa a ChatGPT cuando intentaban encontrar una solución para el código fuente y el equipo defectuoso y cuando le pedían al chatbot que generará actas de reuniones.

Del mismo punto anterior, vemos como la SEGURIDAD también puede ser vulnerada, al filtrar datos relevantes que quedan a merced de piratas cibernéticos.

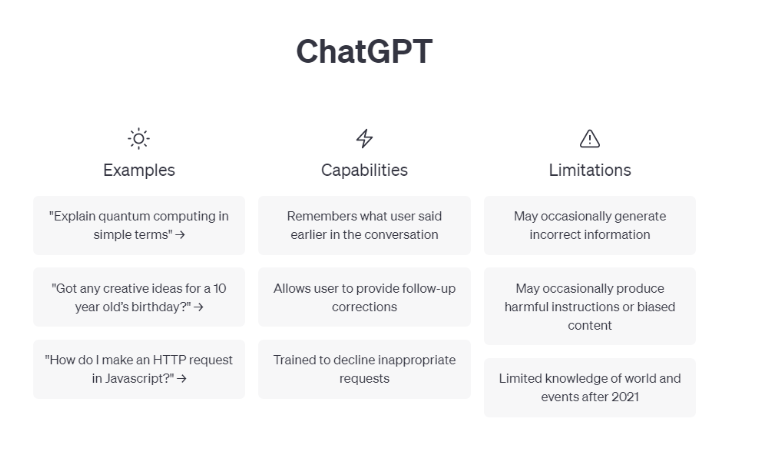

VERACIDAD. Al usar herramientas de Inteligencia Artificial es vital validar la información. Los sistemas pueden "alucinar" o inventar información.

Y por supuesto, la ÉTICA, la cual puede verse afectada por utilizar esta información de forma indiscriminada sin tomar medidas mínimas de verificación y sin respetar derechos de autor.

Vivimos una época de grandes avances, de los cuales debemos tomar ventaja de forma consciente y responsable para lograr optimizar y mejorar nuestro trabajo, siempre aportando y generando valor a las investigaciones, utilizando la AI como una guía y no como una solución a nuestros proyectos.